Jüngster Halbleiterbericht von Morgan Stanley: Der KI-Rechenleistungszyklus breitet sich auf Speicher und Verpackung aus

Am 5. März 2026 veröffentlichte Morgan Stanley einen Forschungsbericht zur Halbleiterindustrie in Asien:

„Greater China Semiconductors – Bullish on Cloud, Memory and Optical Outlook; Accumulating Ahead of GTC“.

Der Bericht stellt fest, dass der Kernantrieb der Halbleiterindustrie weiterhin vom Aufbau von KI-Infrastrukturen kommt, jedoch verändert sich der Fokus des Marktes.

War der KI-Zyklus 2023–2024 primär auf GPU konzentriert, beginnt ab 2025–2026 die KI-Nachfrage sich auf breitere Bereiche der Halbleiter-Lieferkette auszudehnen, einschließlich:

Memory (Speicher)

Advanced Packaging (Fortschrittliche Verpackung)

Kundenspezifische ASIC-Chips

Rechenzentrum-Netzwerke

Morgan Stanleys Fazit lautet:

Investitionen in KI-Rechenleistung befinden sich weiterhin in der Expansionsphase, und die Halbleiterbranche tritt in einen neuen strukturellen Nachfragezyklus ein.

I. Cloud-Kapitalausgaben werden weiterhin ausgebaut

Die Hauptnachfrage nach KI-Halbleitern kommt weiterhin von Cloud-Anbietern.

Die Statistiken von Morgan Stanley zeigen:

Im vierten Quartal 2025 stiegen die Kapitalausgaben der vier größten Cloud-Anbieter (Amazon, Microsoft, Google, Meta) weltweit im Vergleich zum Vorjahr um 64 %.

Bei Einbeziehung der zehn größten Cloud-Anbieter weltweit erwartet Morgan Stanley:

Im Jahr 2026 werden die weltweiten Cloud-Kapitalausgaben fast 685 Milliarden US-Dollar erreichen.

Langfristige Prognosen: NVIDIA-CEO Jensen Huang sagte:

Das Investitionsvolumen in globale KI-Infrastrukturen könnte bis 2028 eine Billion US-Dollar erreichen.

Dieser Trend bedeutet:

Der Aufbau von KI-Infrastrukturen befindet sich weiterhin in einem Expansionszyklus statt am befürchteten Höhepunkt.

II. KI-Inferenz verändert die Struktur der Speicher-Nachfrage

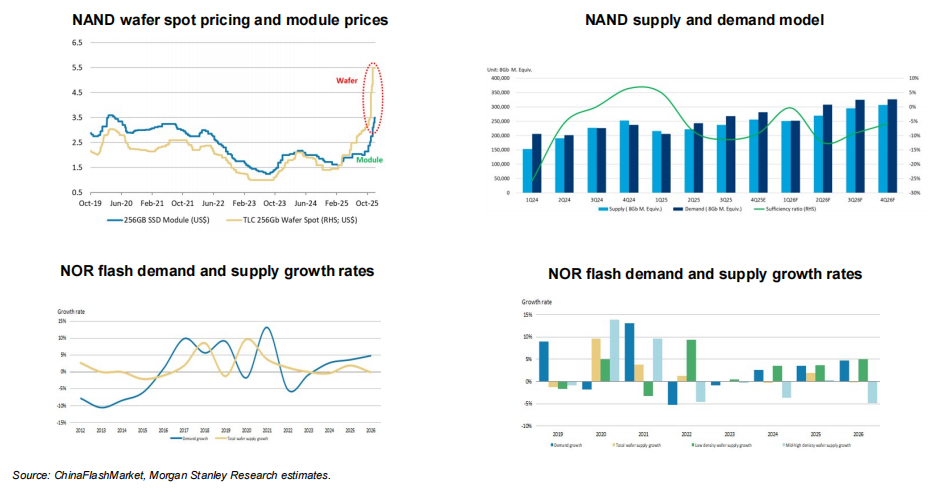

Morgan Stanley sieht den am meisten unterschätzten Aspekt im aktuellen KI-Zyklus bei derSpeichernachfrage.

KI-Inferenzmodelle müssen große Mengen an Kontextdaten (Context Memory) speichern,

dadurch wird eine neue Speicherarchitektur notwendig.

Der Bericht bringt das Konzept ins Spiel:

ICMS (Inference Context Memory Storage)

Das heißt ein spezielles Kontextspeichersystem für KI-Inferenz.

Nach Morgan Stanley-Berechnungen:

Bis 2027 wird der Bedarf durch KI-Inferenz zusätzlich 13 % des weltweiten NAND-Speichermarkts beanspruchen.

Gleichzeitig könnte der NOR-Flash-Markt in einen Zustand von Angebotsknappheit geraten.

Der Bericht stellt fest:

Die KI-Speichernachfrage könnte einen neuen Aufwärtszyklus in der Speicherindustrie auslösen.

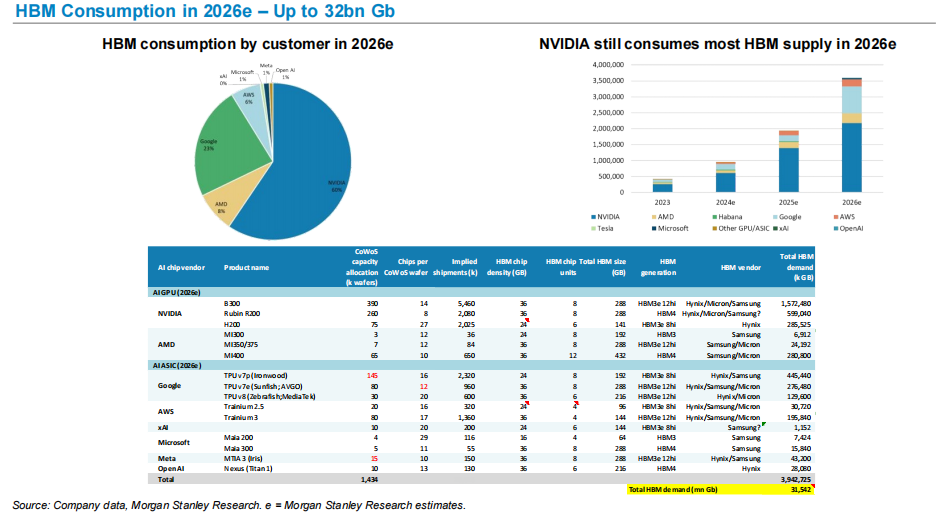

III. HBM wird zum kritischen Engpass der KI-Rechenleistung

Einer der wichtigsten Faktoren für die Verbesserung der KI-Chipleistung ist High Bandwidth Memory (HBM).

Morgan Stanley prognostiziert:

Die weltweite HBM-Nachfrage wird 2026 etwa 32 Milliarden Gb erreichen.

Im Nachfrageprofil:

NVIDIA bleibt der größte HBM-Verbraucher.

Die Nachfrage nach HBM für KI-GPUs und KI-ASIC-Chips steigt rasant und macht HBM zu einer Schlüsselressource in der KI-Rechenleistung-Lieferkette.

Dieser Trend erklärt auch, warum:

SK Hynix

Micron

Samsung

im KI-Zyklus besonders hervorstechen.

IV. Fortschrittliche Verpackung wird zum Produktionsengpass für KI-Chips

KI-GPUs benötigen nicht nur fortschrittliche Verfahren, sondern sind auch stark auf fortschrittliche Verpackungstechnologien angewiesen.

Morgan Stanley prognostiziert:

Die CoWoS-Produktionskapazität von TSMC für fortschrittliche Verpackung könnte bis 2026 auf 125.000 Wafer pro Monat steigen.

Die Nachfrage kommt hauptsächlich von:

NVIDIA

AMD

Eigene KI-Chips der großen Cloud-Anbieter

Fortschrittliche Verpackung wird somit zum wichtigen Engpass in der KI-Chip-Lieferkette.

V. KI-ASIC wächst schnell

Neben GPU entwickeln Cloud-Anbieter ihre eigenen KI-Chips in großem Maßstab.

Zu den aktuellen Hauptprojekten gehören:

Google TPU

Amazon Trainium

Microsoft Maia

Meta MTIA

Morgan Stanley geht davon aus, dass die Lieferzahlen von KI-ASIC in den kommenden Jahren weiter steigen werden.

Zum Beispiel:

Die Lieferzahlen der AWS Trainium-Chipserie werden in den nächsten Jahren weiter steigen.

Das bedeutet, der zukünftige KI-Rechenleistungsmarkt wird sich zu folgendem Bild entwickeln:

GPU + ASIC Parallelentwicklung.

VI. Chinas KI-GPU-Alternativen werden vorangetrieben

Der Bericht gibt auch eine Prognose zur chinesischen KI-Chipindustrie ab.

Morgan Stanley prognostiziert:

Chinas GPU-Eigenversorgungsrate wird von 34 % im Jahr 2024 auf 50 % im Jahr 2027 steigen.

Gleichzeitig wird der chinesische KI-Cloud-Markt 2027 voraussichtlich folgende Größe erreichen:

etwa 48 Milliarden US-Dollar.

Dies bedeutet, dass sich die globale KI-Rechenleistungs-Lieferkette regional strukturiert.

Meine Einschätzung

Wenn man den gesamten Bericht in einem Satz zusammenfasst, ist es ganz einfach:

Der KI-Halbleiterzyklus dehnt sich von „Rechenleistung“ auf „die gesamte Lieferkette“ aus.

In der Anfangsphase lag der Fokus des Marktes auf GPU.

Mit wachsender KI-Infrastruktur verbreiten sich die Anforderungen auf:

Speicher

Fortschrittliche Verpackung

Netzwerkchips

Kundenspezifische ASIC

Das bedeutet:

KI ist nicht mehr nur ein einzelner Chip-Zyklus, sondern ein struktureller Bedarf der gesamten Halbleiter-Lieferkette.

Für die Halbleiterbranche ist

die eigentliche Veränderung nicht die GPU-Nachfrage, sondernder langfristige Aufbau von Rechenleistungs-Infrastruktur.

Haftungsausschluss: Der Inhalt dieses Artikels gibt ausschließlich die Meinung des Autors wieder und repräsentiert nicht die Plattform in irgendeiner Form. Dieser Artikel ist nicht dazu gedacht, als Referenz für Investitionsentscheidungen zu dienen.

Das könnte Ihnen auch gefallen

TransMedics: Ist dies ein technischer Ausbruch oder ein Zeichen für eine überkaufte Umkehr?

Anthropic erlebt im Jahr 2026 ein enormes Wachstum, und es ist erst März.

Der Dow fällt um über 1.000 Punkte, während sich die Iran-Krise außerhalb des Nahen Ostens zuspitzt