Ключові моменти конференції Google Cloud Next: AI Agent переходить до масштабування, чіпи для інферентингу стають окремою траєкторією зростання

Щорічна конференція Google з хмарних технологій Cloud Next 2026 дала чіткий сигнал: битва за корпоративний AI переміщається з "як експериментувати" до "як управляти та масштабно розгортати", і відповіддю Google стала повна вертикальна екосистема — від чипів до платформи. Ця конференція — не просто шоу запуску продуктів, вона знаменує те, що agentic AI проходить критичну межу переходу від доказу концепції до корпоративного виробничого розгортання.

За даними Zhyvop Trading Terminal, аналітик JPMorgan Doug Anmuth після конференції написав: "Перехід від експериментів до розгортання, ймовірно, є найбільш переконливим доказом того, що агентний AI подолав прірву між доказом концепції та переходом до корпоративних робочих навантажень." Данні з боку попиту підтверджують цей висновок: перша модель Google через прямий API вже обробляє 16 мільярдів tokens за хвилину, що значно більше минулого кварталу (10 мільярдів); близько 75% клієнтів Cloud вже використовують їхні AI-продукти; платні щомісячні активні користувачі Gemini Enterprise зросли на 40% квартал до кварталу.

Три організації — JPMorgan, Bank of America Securities та Citi Research — після конференції зберегли рекомендацію купувати Alphabet, цільові ціни склали 395, 370 та 405 доларів. Загальна логіка така: доходи Cloud зростають швидше, ніж рекламний бізнес, "Комбінація Gemini моделей + власні TPU + корпоративна платформа оркестрації" створює диференційований moat і має перспективу стати прямим драйвером фондового курсу. Тим часом Sundar Pichai у основній доповіді озвучив діапазон капітальних витрат на 2026 рік — від 175 до 185 мільярдів доларів, і ринок зберігає високу увагу до траєкторії capex напередодні звітності.

Проблеми корпоративних клієнтів змінилися: від "як спробувати" до "як управляти"

Якщо минулі два роки Cloud Next були вікном демонстрації технічних можливостей, то цього року акцент змінився на те, як зробити AI з експериментального розгортання для небагатьох компаній масово керованим, контрольованим за витратами виробничим робочим навантаженням.

JPMorgan у своєму звіті розглядає шлях еволюції: у 2024 році основна увага — інтеграція Gemini і Workspace, ранній пошук агентів; у 2025 наголос на A2A протокол і сьому генерацію TPU Ironwood; у 2026 все стосується Agentic Cloud, зручності даних, ефективності AI-інфраструктури й безпеки, і результат — перевод agent від пілота до масштабованої виробничої експлуатації.

Аналітик Citi Research Ronald Josey висловився ще пряміше: З переходом менеджерів до "управління кількома агентами через воркфлоу", компанії переходять від "вміння використовувати моделі" до "зміни процесів за допомогою агентів", і саме на цю міграцію робить ставку Google Cloud, позиціонуючи себе як "ключову операційну систему agentic enterprise".

Цей контекст пояснює, чому інформаційна насиченість презентації фокусувалася на двох рівнях: потужність та мережеві структури для агентних воркфлоу, і апгрейд платформи до "фабрики агентів". Google вирішила не надавати жодних фінансових оновлень,а натомість використала обсяги використання клієнтів для доведення реального виробничого запуску — включаючи те, що всередині Google близько 75% нового коду вже генерується AI і ревізується інженерами, а час усунення безпекових загроз скоротили більше ніж на 90%.

TPU 8 покоління: інференція відділяється від тренування і стає незалежною капітальною історією

На апаратному рівні ключовою структурною зміною стала вперше розділена восьма генерація TPU на дві лінії продуктів: TPU 8t для високопродуктивних тренувальних робочих навантажень, TPU 8i спеціально оптимізований "з нуля" для реального часу інференції.

Логіка "розгалуженої архітектури" найбільш чітко описана в звіті JPMorgan: TPU 8t розширює кластери до понад мільйону чипів завдяки новому Virgo Network fabric, пік продуктивності приблизно втричі більший порівняно з Ironwood, мета — скоротити час тренування моделей з трильйонами параметрів; а TPU 8i використовує нову топологію boardfly network, вбудований SRAM збільшено приблизно втричі, головна задача — подолати затримки та обмеження памʼяті при масштабуванні агентної інференції. Citi додає аспект ефективності: затримка TPU 8i на 5 разів менша за TPU 7, співвідношення продуктивність/долар покращено приблизно на 80%.

Варто звернути увагу на висновки JPMorgan: якщо інференція більше не "повторно використовує тренувальні чипи", а потребує окремих ASIC для оптимізації, це означає, що Google оцінює потребу в обчислювальній потужності інференції як достатньо велику для виділення кремнію та окремої капітальної структури. Це структурно змінює доходи — більше не лише тренування, а постійне споживання інференції створює окрему криву зростання.

Варто зазначити, що всі три звіти згадують, що керівництво не обговорювало можливість продажу TPU стороннім, тобто наразі цей апаратний шлях обслуговує "власне використання плюс хмарні сервіси", і ще не став окремим напрямом апаратної комерціалізації.

Реструктуризація платформи: Vertex AI "апгрейдиться" до єдиного входу для управління корпоративними агентами

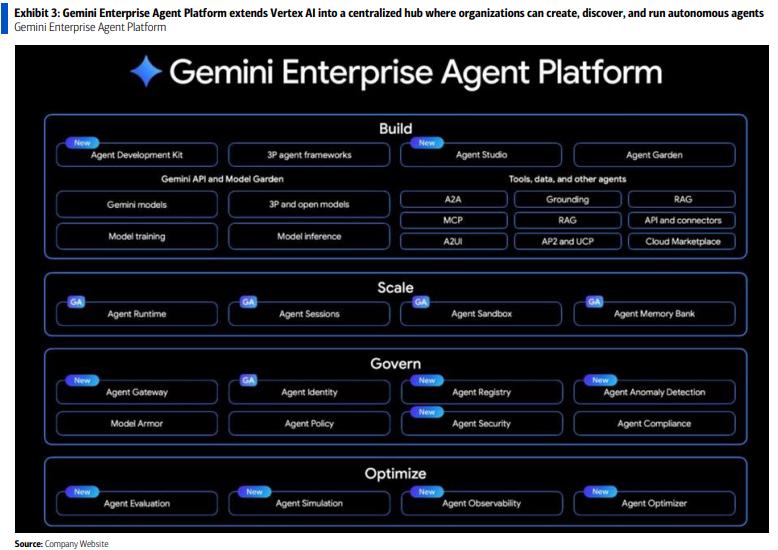

Окрім апаратного, реструктуризація платформи стала ще одним важливим структурним зрушенням цієї конференції. Google запустила Gemini Enterprise Agent Platform, JPMorgan описує це як ефективне "заміщення Vertex AI" — обʼєднання корпоративного створення, оркестрації, управління та безпеки в єдиному вході замість розрізнених модулів.

Bank of America Securities розкладає цю реструктуризацію на три рівні. На інфраструктурному — AI Hypercomputer, де GPU/TPU, мережі, сховище та ПО оптимізації інтегруються в одну архітектуру, охоплюючи весь життєвий цикл від тренування до інференції. На платформному — організація навичок за "build/scale/govern/optimize", включає створення агентів без/з мінімальним кодом, централізоване управління, оркестрація між екосистемами (Google Workspace, Microsoft 365 та 3rd party), а також вбудовані засоби спостереження та трасування. На застосунковому — Workspace Intelligence поглиблює агентні функції у Gmail, Docs, Chat тощо, дозволяючи виконувати багатоступеневі завдання між додатками.

Інтерпретація Citi трохи інша: вони акцентують, що головна цінність платформи — дозволити компаніям запускати кілька agent через одну систему управління процесами. Це означає: поріг масштабного розгортання agent залежить не лише від технічного рівня компанії, а й від стандартизованості можливостей платформи, що дозволяє більше компаніям обійти кастомізацію й напряму перейти до продуктивного розгортання.

Google підтверджує даними — "повний AI-стек" вже працює у виробничому середовищі

На конференції фінансові дані не розкривались, Google використовувала внутрішні вимірювані кейси для підтвердження того, що "agent вже у виробництві". Citi окреслює ці кейси за чотирма напрямками:

По R&D — близько 75% нового коду генерується AI та затверджується інженерами; Citi дає порівняння: у жовтні 2025 це було близько 50%, у першому кварталі 2025 — близько 30%, темпи проникнення вражаючі. Один проект міграції коду завершився в шість разів швидше, ніж рік тому.

В маркетингу та контент-продакшені — цикл від концепції до відеоматеріалу скоротився на 70%, супроводжуючись підвищенням конверсії на 20%.

В безпеці — Google Cloud автоматично обробляє десятки тисяч неструктурованих звітів про безпекові загрози щомісяця, час помʼякшення ризиків скоротився понад 90%; безпекові можливості базуються на інтеграції Wiz і Mandiant. Citi також зазначає, що AI скоротив "середній час експлуатації вразливості" до "мінус семи днів" — тобто атаки відбуваються до того, як випущено патч, що робить автоматичну оркестрацію безпеки стратегічно важливою.

В обслуговуванні клієнтів — YouTube за шість тижнів розгорнув AI голосового агента, що покриває сцени дзвінків NFL Sunday Ticket і YouTube TV; Citi підкреслює низьку затримку, точність і двомовність.

Ці кейси у всіх трьох звітах допомагають відокремити "реальне корпоративне навантаження" від "демонстраційних Demo", щоб підтримати висновок про ймовірне зростання Cloud у поточному сезоні.

175—185 мільярдів доларів capex — це "ще не зміна", а не "максимум вже досягнуто"

Sundar Pichai у головній доповіді озвучив діапазон капітальних витрат на 2026 рік — 175–185 мільярдів доларів, що було єдиною заявою щодо фінансової величини на цьому заході й стало предметом розбіжностей у трьох звітах.

JPMorgan інтерпретує більш прагматично: публічна згадка діапазону підвищує ймовірність, що у звітності наступного тижня вони "залишать керівництво незмінним" — це не підтвердження, що capex вже досяг максимуму. Прогноз JPMorgan: 181 мільярд в 2026, 226 млрд у 2027 (ріст ~25% YoY) — на 12% вище консенсусу ринку. Звіт також вказує на зворотний сигнал: Amin Vahdat і Jeff Dean наголосили, що AI ще перебуває в фазі обмеженої пропозиції, що означає — capex ще може рости, і діапазон не є потолком.

Bank of America Securities прямо ставить Capex/FCF тиск у список ризиків: AI-інвестиції збільшують capex, зменшують вільний cash-flow — це найбільш прямий фактор зниження маржі.

Загальний консенсус: Cloud Next відповідає на питання "чи є у Google agentic AI продукти та інфраструктура", а у наступних кварталах треба відповісти, чи ці вкладення можуть забезпечити ріст Cloud та маржу без значних втрат cash-flow.

Три інвестбанки зберігають рекомендацію купувати, але ризики різні

На рівні інвестиційних висновків всі три звіти зберігають buy, але анкерна оцінка й аргументи дещо різняться.

JPMorgan залишає Overweight, цільова ціна на 12 міс — 395 доларів, на основі ~29x їх прогнозу GAAP EPS 2027 — 13,51 дол. Alphabet є "top overall pick", логіка — ставка не лише на cloud, а й на Search і YouTube рекламу, що ще мають потенціал, не-рекламний бізнес розширюється, а Waymo може дати опціонну вартість.

Bank of America Securities залишається buy — 370 доларів, це 27x core GAAP EPS 2027 плюс cash per share; вагу Cloud в SOTP підвищують, дають орієнтовну модель на ~1,2 трильйона доларів за 10x revenue, вважають що маржа cloud і монетизація AI дають потенціал вищої мультиплікації.

Citi Research зберігає buy, ставить максимальну ціль — 405 доларів (~29x GAAP 2027 EPS — 13,92 дол.), премія залежить від двох чинників — прискорення доходів Google Cloud завдяки TPU і Gemini, а також resilience Search business завдяки високому volume queries.

З точки зору ризиків всі три звіти згадують посилення конкуренції в AI і ймовірний тиск через розподіл search traffic, JPMorgan і Bank of America Securities окремо ставлять EU DMA compliance; Bank of America Securities визначає "повільніше, ніж очікують, інтеграцію LLM у Search або вплив на доходи від Search" як основний короткостроковий ризик, а ключова точка валідації — публікація квартальної звітності 29 квітня після закриття ринку.

Відмова від відповідальності: зміст цієї статті відображає виключно думку автора і не представляє платформу в будь-якій якості. Ця стаття не повинна бути орієнтиром під час прийняття інвестиційних рішень.

Вас також може зацікавити

StakeStone (STO) 24-годинна амплітуда 40,8%: обсяг торгів зріс на 261%, що спричинило відскок