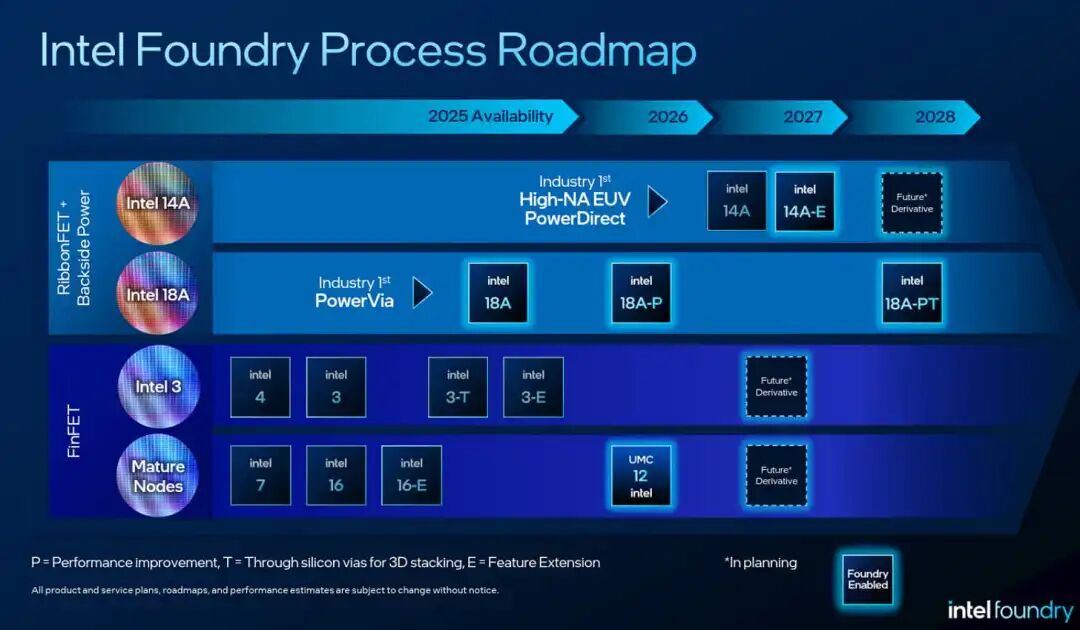

隨著智能合約從小型實驗發展成管理超過4000億美元資產的主要金融系統,安全性變得越來越關鍵。

與傳統軟體不同,大多數區塊鏈程式在部署後無法更改,這意味著即使是微小的編碼錯誤也可能導致永久的財務損失。

為了評估人工智慧在這種高風險環境下的表現,OpenAI、Paradigm 和 OtterSec 的研究人員開發了 EVMbench。

它並未採用簡單的測試挑戰,而是利用來自40個區塊鏈專案的120個真實漏洞,使評估更貼近現實狀況。

對此,OpenAI 的部落格文章指出,

「我們評估了一系列前沿代理,發現他們能夠從頭到尾在真實的區塊鏈實例中發現並利用漏洞。」

文章還補充道,

「我們釋出程式碼、任務與工具,以支持持續測量這些能力並推動未來在安全領域的研究。」

AI 是否真的正在重塑智能合約安全?

雖然 AI 大幅提升了審計與修復漏洞的能力,但它同時也可能利用系統弱點。為了解決這一問題,EVMbench 協助研究人員追蹤這些風險。

它同時引導高價值金融系統的負責任 AI 發展。

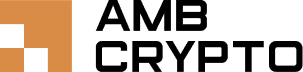

也就是說,EVMbench 在三個階段測試 AI 代理。

每個階段代表不同的技術難度層級,反映出日益增加的安全責任。

社群對這項努力表示肯定

對這一舉措表示認可,一位 X 用戶指出,

「這是智能合約安全的分水嶺時刻。僅僅六個月內,利用成功率從31.9%躍升到72.2%,顯示 AI 代理不僅越來越擅長閱讀程式碼——他們正在掌握完整的攻擊鏈。」

另一位用戶補充道,

「利用成功率提升六倍是驚人的進步,但也令人擔憂攻擊技能提升的速度如此之快。」

近期引發轟動的事件

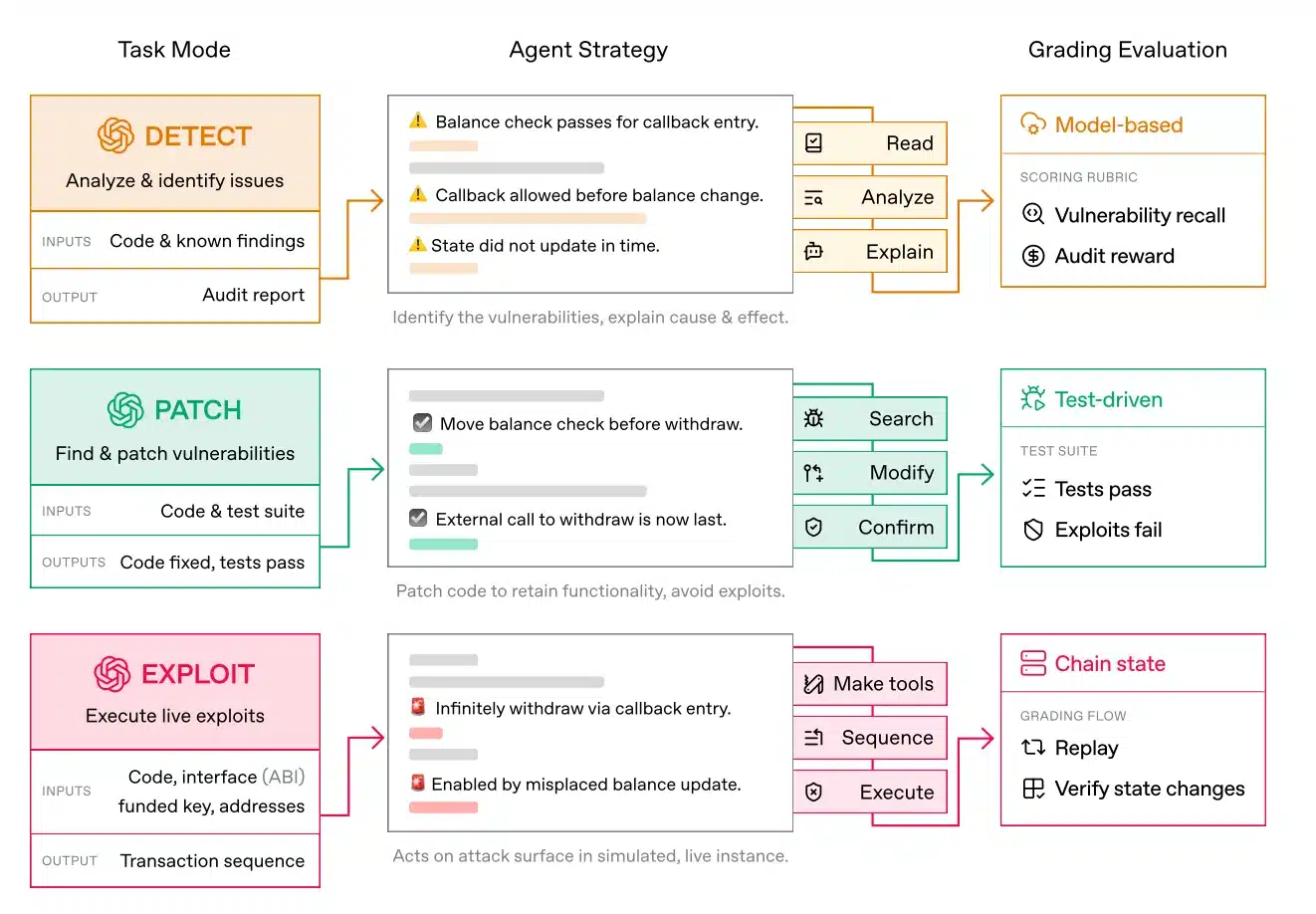

然而,儘管充滿樂觀情緒,OpenAI 推出 EVMbench 不久後,卻發生了一件難以置信的事。涉及 Claude Opus 4.6 的利用事件引發了對「vibe-coded」智能合約風險的嚴重關切。

在這起事件中,AI 協助撰寫了有漏洞的 Solidity 程式碼,錯誤地將 cbETH 資產的價格設為 1.12 美元,而非其實際價值約 2,200 美元,導致清算並造成近 178 萬美元的損失。

這顯示,在沒有謹慎人工審查的情況下,過度信任 AI 處理關鍵金融邏輯,可能讓小錯誤演變成重大損失。

限制仍然存在

EVMbench 具有明顯的限制。它僅涵蓋 120 個精選漏洞,無法評估新發現的問題。

偵測模式也會產生誤判。Patch 與 Exploit 任務數量有限,反映出創建這些任務所需的大量人工。

此外,沙盒環境無法完全反映現實世界的狀況,例如跨鏈活動、時序複雜性以及長期網路歷史。

不用說,隨著區塊鏈應用加速,其濫用方式也在迅速演變。

近期 Group-IB 的研究也顯示,DeadLock 勒索軟體正在利用Polygon 智能合約來隱藏伺服器基礎設施並規避偵測。

這些發展共同顯示,原本為提升透明度與信任而設計的智能合約,正越來越多地被重新利用為網路犯罪工具。

總結

- 像 EVMbench 這樣的工具協助研究人員在真實安全環境下衡量 AI 能力。

- 有限的資料集和受控環境仍難以呈現區塊鏈現實的複雜性。